Den digitale verdenen er i stadig utvikling, og en katalysator som skiller denne plattformen fra de andre er brukergenerert innhold. Selv om selskaper over hele verden har sine nettsider og dedikerte sosiale medier tilstedeværelse, er det mer sannsynlig at brukere stoler på meningene til sine medkunder enn å gå etter virksomhetens ord.

Mer enn 4.26 milliarder mennesker var aktive brukere av sosiale medier i 2021. Et antall spådd å røre 6 milliarder-grensen innen 2027. Mengden innhold som ble generert, fanget, delt og konsumert på global skala, nådde 64.2 zettabyte i 2020.

Med nytt innhold som genereres og konsumeres i et svimlende tempo, har det blitt viktig at merkevarer holder oversikt over innholdet som er vert på deres plattformer. Online plattformer skal være og forbli et trygt miljø for sine brukere.

[Les også: Forstå automatisert innholdsmoderering]

Hva er innholdsmoderering og hvorfor?

Brukergenerert innhold driver sosiale medieplattformer, og innholdsmoderasjon refererer til screening av dette innholdet for upassende eller støtende innlegg. Forretnings- og sosiale medieplattformer har en spesifikk standard for overvåking av vertsinnholdet.

Retningslinjene kan omfatte alt fra vold, ekstremisme, hatmeldinger, nakenhet, brudd på opphavsretten eller noe støtende. Det publiserte innholdet vil bli flagget og fjernet hvis det ikke tilfredsstiller standarden.

Ideen bak innholdsmoderering er å sikre at innholdet er i samsvar med merkevarens idealer og opprettholder verdiene anstendighet, tillit og sikkerhet.

Moderering av innhold er avgjørende for at bedrifter skal opprettholde forretningsstandarder, merkevareimage, omdømme og troverdighet. Hvert sekund gjør den svimlende mengden brukergenerert innhold som legges ut på plattformer det utfordrende for merkevarer å holde seg unna støtende og upassende innhold, tekst, videoer og bilder. Strategi for innholdsmoderering hjelper merkevarer med å opprettholde sitt image samtidig som det lar brukere uttrykke seg og stenger støtende, eksplisitt og voldelig innhold.

Hvilke innholdstyper kan du moderere?

Algoritmer for innholdsmoderering håndterer vanligvis tre eller en kombinasjon av disse innholdstypene.

tekst

Den store mengden tekst – fra kommentarer til artikler i full lengde – som trenger moderering er ganske svimlende. Tekstinnlegg er tilgjengelig nesten hvor som helst i form av kommentarer, artikler, foruminnlegg, diskusjoner i sosiale medier og andre innlegg.

Algoritmer for moderering av tekstinnhold skal kunne skanne teksten i forskjellige lengder og stiler for uønsket innhold. Dessuten kan tekstmoderering være en vanskelig oppgave på grunn av kompleksiteten i språk og kulturelle nyanser.

Bilder

Bildemoderering er mye enklere enn tekstmoderering, men det er viktig å ha riktige retningslinjer eller standarder på plass.

I tillegg, siden kulturelle forskjeller kan spille inn ved moderering av bilder, er det avgjørende å grundig forstå og få kontakt med brukerfellesskapet på flere geografiske steder.

videoer

Moderering av videoinnhold er svært vanskelig, siden moderering av videoer kan være tidkrevende, i motsetning til tekst eller bilder. Moderatoren må se hele videoen før han anser den som egnet eller uegnet til konsum. Selv om bare noen få bilder i videoen er eksplisitte eller forstyrrende, vil det tvinge moderatoren til å fjerne hele innholdet.

Live Streaming

Livestreaming er kanskje det mest utfordrende innholdet å moderere. Det er fordi video og tilhørende tekstmoderering må skje samtidig med strømmingen.

Hvordan fungerer innholdsmoderering?

For å komme i gang med å moderere innholdet på plattformen din, bør du først få på plass standarder eller retningslinjer som bestemmer upassende innhold. Disse retningslinjene hjelper moderatorer med å flagge innhold for fjerning.

Definer følsomhetsnivået eller terskelinnhold moderatorer bør vurdere når de vurderer innhold. Terskelen bør defineres basert på merkevaren din, typen virksomhet, brukernes forventninger og beliggenhet.

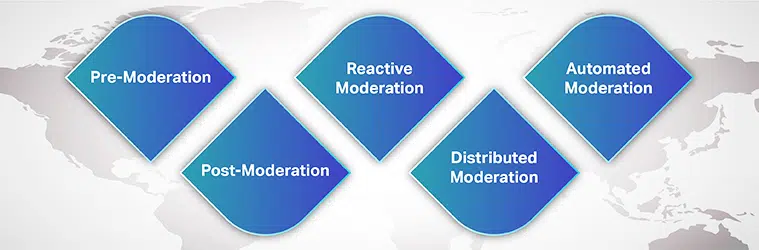

Typer innholdsmoderering

Du kan velge mellom mange moderasjonsprosesser for ditt merkebehov og brukersamtykke. Noen av dem er:

Forhåndsmoderering

Før innholdet vises på nettstedet ditt, står det i køen for moderering. Først etter at innholdet er gjennomgått og ansett som egnet for konsum, publiseres det på plattformen. Selv om dette er en sikker metode for å blokkere eksplisitt innhold, er det tidkrevende.

Post-moderering

Postmoderering er standardmetoden for innholdsmoderering der det er en avveining mellom brukerengasjement og moderering. Selv om brukere har lov til å legge inn bidragene sine, står det fortsatt i kø for moderering. Hvis innholdet har blitt flagget, blir det gjennomgått og fjernet. Bedrifter streber etter å oppnå en kortere gjennomgangstid, slik at upassende innhold ikke får være på nettet for lenge.

Reaktiv moderering

I reaktiv moderering oppfordres brukerfellesskapet til å flagge upassende innhold som bryter med fellesskapet regler og retningslinjer. I denne metoden rettes fellesskapets oppmerksomhet mot innholdet som trenger moderering. Det støtende innholdet kan imidlertid forbli på plattformen i lengre perioder.

Distribuert moderering

I en distribuert modereringsmetode kan nettsamfunnet gjennomgå, flagge og fjerne innhold de finner støtende og mot retningslinjer ved hjelp av et rangeringssystem.

Automatisert moderering

Som navnet antyder, bruker automatisert moderering ulike verktøy og systemer for å flagge ord eller setninger og avvise innsendinger. Det fungerer ved å filtrere ut visse forbudte ord, bilder og videoer ved hjelp av maskinlæringsalgoritmer.

Selv om teknologidrevet moderering blir utbredt, menneskelig måtehold under vurdering kan ikke ses bort fra. Bedrifter bruker ideelt sett en kombinasjon av automatiserte verktøy og menneskelige moderatorer, i det minste for komplekse situasjoner.

[Les også: Kasusstudie – innholdsmoderering]

Hvordan hjelper maskinlæring innholdsmoderering?

Med mer enn 5 milliarder mennesker som bruker internett og over 4 milliarder aktive på sosiale medier, er det ikke lett å bli forbauset over det store antallet bilder, tekst, videoer, innlegg og meldinger som genereres daglig. Dette gigantiske innholdet må modereres på en eller annen måte slik at brukere som får tilgang til deres sosiale mediesider kan få en hyggelig og berikende opplevelse.

Moderering av innhold ble til som løsningen for å fjerne innhold som er eksplisitt, støtende, fornærmende, svindel eller mot merkeets etos. Tradisjonelt har bedrifter vært helt avhengige av menneskelige moderatorer for å vurdere online brukergenerert innhold publisert på deres plattformer. Men helt avhengig av menneskelige moderatorer kan det gjøre prosessen tidkrevende, kostbar og ineffektiv.

Bedrifter bruker nå maskinlæringsalgoritmer for å automatisk og effektivt moderere innhold. AI-drevet innholdsmoderering har gjort hele prosessen effektiv, raskere, konsekvent og kostnadseffektiv.

Selv om denne prosessen ikke eliminerer behovet for menneskelige moderatorer – menneske-i-løkken, bidrar bidraget fra menneskelige moderatorer til å håndtere komplekse problemer. Dessuten forstår menneskelige moderatorer språknyanser, kulturelle forskjeller og kontekst bedre. Når automatiserte verktøy brukes, med hjelp fra menneskelige moderatorer, reduserer det den psykologiske effekten av eksponering for utløsende innhold.

Utfordringer ved moderering av innhold

En annen stor utfordring når det gjelder å utvikle en nøyaktig innholdsmodereringsalgoritme er språk. En pålitelig innholdsmodereringsapplikasjon skal kunne gjenkjenne flere språk og forstå kulturelle nyanser, sosiale kontekster og språklig dynamikk.

Siden et språk går gjennom flere endringer over tid, ettersom visse ord som var uskyldige i går kunne ha gjort seg kjent i dag – må ML-modellen holde tritt med den skiftende verden. For eksempel kan et nakenmaleri være eksplisitt og voyeuristisk eller bare kunst.

Hvordan a del av innholdet oppfattes eller anses som upassende, avhenger av konteksten. Og det er avgjørende å ha konsistens og standarder på plattformen din, slik at brukerne dine kan stole på moderasjonsarbeidet ditt.

En typisk bruker prøver alltid å finne smutthull i retningslinjene dine og omgå modereringsregler. Imidlertid bør ML-algoritmen din være i stand til å utvikle seg med de skiftende tidene kontinuerlig.

Til slutt er det spørsmålet om skjevhet. Det er avgjørende å diversifisere treningsdatabasen og treningsmodellene for å oppdage kontekst. Selv om det kan virke utfordrende å utvikle en pålitelig innholdsmodereringsalgoritme, starter det med å få tak i treningsdatasett av høy kvalitet.

Tredjepartsleverandører med riktig ekspertise og erfaring i å levere tilstrekkelige opplæringsdatasett er de rette stedene å begynne.

Hver virksomhet med sosial tilstedeværelse trenger en nyskapende løsning for innholdsmoderering som bidrar til å bygge kundens tillit og en upåklagelig kundeopplevelse. For å bygge applikasjonen og trene maskinlæringsmodellen din, trenger du tilgang til en database av høy kvalitet uten skjevheter, tilpasset de siste språklige og markedsspesifikke innholdstrendene.

Med vår mange års erfaring med å hjelpe bedrifter med å lansere AI-modeller, Shaip tilbyr omfattende datainnsamlingssystemer som tilfredsstiller ulike behov for innholdsmoderering.