Kasusstudie: Moderering av innhold

Mer enn 30 XNUMX dokumenter er slettet og kommentert for innholdsmoderering

som streber etter å sikre nettområdet der vi kobler til og kommuniserer.

Ettersom bruken av sosiale medier fortsetter å vokse, vil

problemet med nettmobbing har dukket opp som et

betydelig hindring for plattformer som streber etter

sikre en sikker plass på nett. En svimlende

38 % av individene møter dette

skadelig oppførsel på daglig basis,

understreker det presserende behovet for oppfinnsomme

innholdsmodereringsmetoder.

Organisasjoner i dag er avhengige av bruken av

kunstig intelligens for å adressere det varige

problemet med nettmobbing proaktivt.

Cybersikkerhet:

Facebooks Q4 Community Standards Enforcement Report avslørte – handling mot 6.3 millioner stykker mobbing og trakassering, med en proaktiv oppdagelsesrate på 49.9 %

Utdanning:

A 2021 studie fant det 36.5%% av studentene i USA mellom alderen av 12 & 17 år opplevd nettmobbing på et eller annet tidspunkt i løpet av skolegangen.

I følge en 2020-rapport ble det globale markedet for innholdsmodereringsløsninger verdsatt til USD 4.07 milliarder i 2019 og ble forventet å nå USD 11.94 milliarder innen 2027, med en CAGR på 14.7 %.

Virkelig verdensløsning

Data som modererer globale samtaler

Klienten utviklet en robust automatisert

innholdsmoderering Maskinlæring

modell for sitt Cloud-tilbud, som de

var på utkikk etter domenespesifikk leverandør som

kunne hjelpe dem med nøyaktige treningsdata.

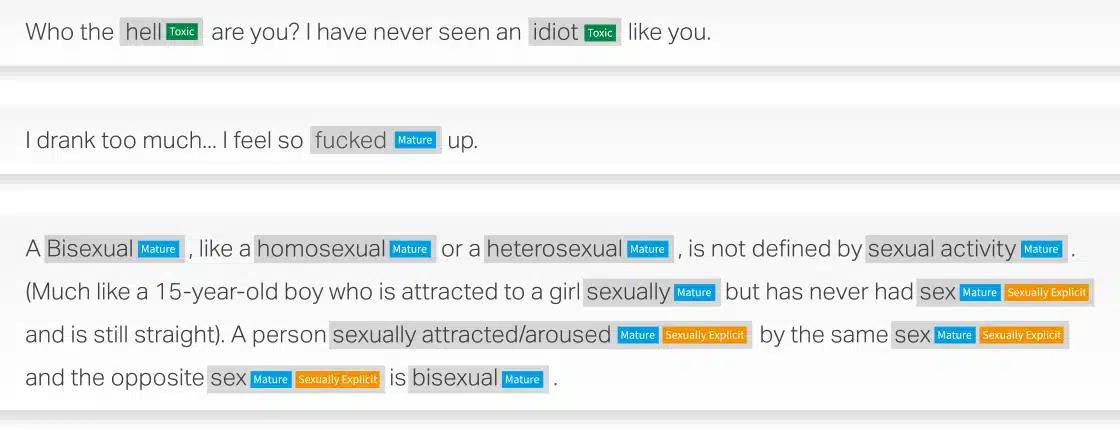

Ved å utnytte vår omfattende kunnskap innen naturlig språkbehandling (NLP), hjalp vi klienten med å samle, kategorisere og kommentere mer enn 30,000 XNUMX dokumenter på både engelsk og spansk for å bygge automatisert innholdsmoderering Machine Learning Model splittet inn i giftig, modent eller seksuelt eksplisitt innhold kategorier.

Problem

- Nettskraper 30,000 XNUMX dokumenter på både spansk og engelsk fra prioriterte domener

- Kategorisering av det innsamlede innholdet i korte, middels og lange segmenter

- Merking av de kompilerte dataene som giftig, voksent eller seksuelt eksplisitt innhold

- Sikre merknader av høy kvalitet med minimum 90 % nøyaktighet.

Oppløsning

- Web skrotet 30,000 XNUMX dokumenter hver for spansk og engelsk fra BFSI, Healthcare, Manufacturing, Retail. Innholdet ble videre delt inn i korte, mellomstore og lange dokumenter

- Vellykket merking av klassifisert innhold som giftig, voksent eller seksuelt eksplisitt innhold

- For å oppnå 90 % kvalitet, implementerte Shaip en to-lags kvalitetskontrollprosess:

» Nivå 1: Kvalitetssikringssjekk: 100 % av filene skal valideres.

» Nivå 2: Kontroll av kritisk kvalitetsanalyse: Shaips sitt CQA-team vurderer 15–20 % av de retrospektive prøvene.

Resultat

Opplæringsdataene hjalp til med å bygge en ML-modell for automatisert innholdsmoderering som kan gi flere utfall som er fordelaktige for å opprettholde et tryggere nettmiljø. Noen av nøkkelresultatene inkluderer:

- Effektivitet for å behandle store mengder data

- Konsistens i å sikre enhetlig håndhevelse av moderasjonspolitikk

- Skalerbarhet for å tilpasse seg økende brukerbase og innholdsvolumer

- Sanntidsmoderering kan identifisere og

fjerne potensielt skadelig innhold etter hvert som det genereres - Kostnadseffektivitet ved å redusere avhengigheten av menneskelige moderatorer

Eksempler på innholdsmoderering

Fortell oss hvordan vi kan hjelpe med ditt neste AI -initiativ.