I dag utforsker over 5.19 milliarder mennesker internett. Det er et stort publikum, er det ikke?

Selve volumet av innhold generert på internett er intet mindre enn svimlende. Fra oppdateringer på sosiale medier og blogginnlegg til brukergenererte kommentarer og multimedieopplastinger, er den elektroniske verden et stort og dynamisk depot av informasjon.

Likevel er ikke alt innhold bra. Noen kan fornærme ulike grupper på grunn av alder, rase, kjønn, nasjonalitet eller etnisitet. Slikt innhold trenger en nøye overvåking. Dette sikrer fred og harmoni for alle.

Derfor kommer det presserende behovet for innholdsmoderering. Selv om den manuelle gjennomgangen er effektiv, er det visse begrensninger som vi ikke kan ignorere. Og det er her automatisert innholdsmoderering kommer inn som en effektiv løsning. Denne effektive metoden sikrer trygge nettopplevelser og beskytter brukere mot potensiell skade.

I dette stykket skal vi snakke om de uvurderlige fordelene og de forskjellige typene som er tilgjengelige i automatiserte modereringsverktøy (forhåndstrenet med robuste datasett).

Forstå automatisert innholdsmoderering

Automatisert innholdsmoderering bruker teknologi for å overvåke og administrere brukergenerert innhold. I stedet for at mennesker skanner hvert innlegg, gjør algoritmer og maskinlæring det tunge løftet. De identifiserer raskt skadelig eller upassende innhold. Disse systemene lærer av enorme datasett og tar avgjørelser basert på fastsatte kriterier som er forhåndsopplært med human-in-the-loop.

Automatiserte modereringsmetoder for innhold kan være svært effektive. De jobber døgnet rundt og vurderer umiddelbart store innholdsvolumer. Likevel utfyller de også menneskelige anmeldere. Noen ganger er en menneskelig berøring avgjørende for konteksten. Denne blandingen sikrer tryggere nettområder ettersom brukerne får det beste fra begge verdener.

Vil du ha en plattform fri for skadelig innhold? Automatisert innholdsmoderering er veien videre. Vi vil gjøre det mer tydelig når du leser typene og fordelene nedenfor.

[Les også: Den nødvendige guiden til innholdsmoderering]

Typer automatisert moderering

Automatisert innholdsmoderering har utviklet seg betraktelig gjennom årene. Den inneholder nå et spekter av teknologier og tilnærminger, hver utformet for å imøtekomme spesifikke behov. Her er en nærmere titt på de forskjellige typene:

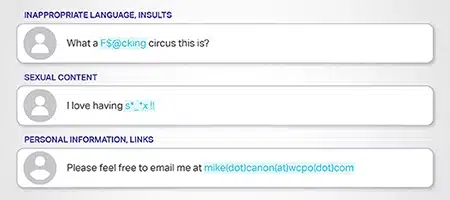

Søkeordbasert moderering

Denne metoden fungerer på forhåndsdefinerte lister over forbudte eller flaggede ord. Når innholdet inneholder disse ordene, nekter systemet enten publiseringen eller sender det til vurdering. For eksempel kan plattformer blokkere eksplisitt språk eller termer knyttet til hatytringer.

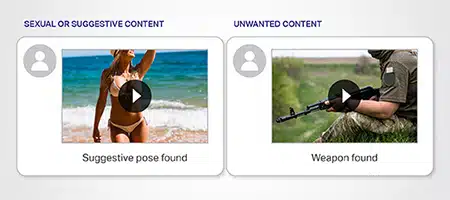

Moderering av bildegjenkjenning

Ved å utnytte kraften til maskinlæring identifiserer denne metoden upassende eller flaggede bilder. Den kan oppdage bilder som fremmer vold, eksplisitt innhold eller opphavsrettsbeskyttet materiale. Avanserte algoritmer analyserer visuelle mønstre for å sikre at ingen skadelige bilder går ubemerket hen.

Moderering av videoanalyse

I likhet med bildegjenkjenning bryter videoanalyse ned videokomponenter bilde for bilde. Den ser etter upassende bilder, lydsignaler eller flagget innhold. Det er uvurderlig på plattformer som YouTube der videoinnhold dominerer.Sentiment analyse moderering

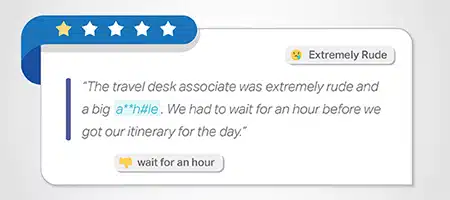

Det er viktig å forstå følelsen eller følelsene bak innholdet. Denne metoden evaluerer innholdstonen og flagger innhold som er altfor negativt, fremmer hat eller fremmer skadelige følelser. Det er spesielt nyttig i fora eller plattformer som fremmer positive fellesskapsinteraksjoner.

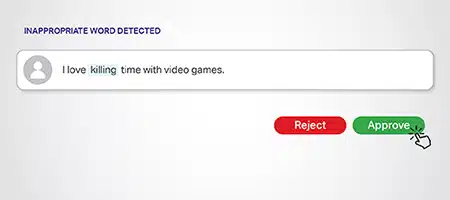

Kontekstuell moderering

Innhold krever ofte kontekst for nøyaktig moderering. Denne metoden evaluerer innhold innenfor dens omgivende kontekst. Det sikrer at ekte innhold, selv med flaggede ord, ikke blir feilaktig blokkert hvis den generelle konteksten er ufarlig. I eksemplet - det inneholder ordet "drep", i kontekst er det godartet, og refererer til den harmløse aktiviteten ved å spille spill

Brukeromdømmebasert moderering

Brukere med en historie med brudd på retningslinjene kan kreve nærmere gransking. Dette systemet modereres basert på brukerens omdømme. De med tidligere overtredelser kan finne innholdet deres gjennomgått strengere enn de med et rent ark.

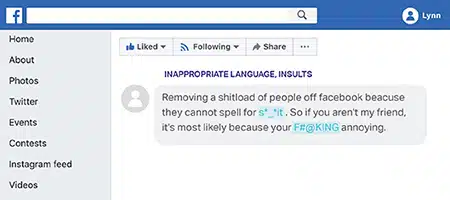

Moderering av sosiale medier

Gitt det enorme innholdet som genereres på sosiale medier, overvåker spesialiserte verktøy disse plattformene. De oppdager potensielle problemer som desinformasjon, falske nyheter eller trolling i sanntid. Det bidrar til å skape et renere og tryggere miljø i sosiale medier.

Fordeler med automatisert moderering

Automatisering bringer ulike fordeler med seg. La oss se nærmere på fordelene som automatisert innholdsmoderering tilbyr:

Effektiv innholdsfiltrering

Med bølgen av brukergenerert innhold (UGC), trenger plattformer systemer for å sile gjennom enorme mengder. Tilbyr automatisk innholdsmoderering effektiv innholdsfiltrering. Det sikrer at kun passende materialer ser dagens lys.

Forbedret digital sikkerhet

Nettsikkerhet er viktig for å laste opp brukernes tillit til å bruke internett. Automatisering bidrar til å opprettholde digital sikkerhet ved å oppdage skadelig innhold. Fra hatytringer til trakassering på nettet holder den slike trusler i sjakk.

Overholdelse av retningslinjer for fellesskapet

Fellesskapets retningslinjer opprettholder plattformens integritet. Automatisering sikrer at disse reglene ikke brytes, og det bidrar til å skape harmoniske nettområder.

Bekjempelse av trakassering og hatytringer på nettet

Automatiserte systemer kan raskt identifisere og eliminere trakassering og hatefulle ytringer på nettet. De sikrer at plattformer forblir innbydende og trygge ved å flagge skadelig innhold.

Adressering av desinformasjon og falske nyheter

I en alder av utbredt desinformasjon, spiller automatisering en sentral rolle. Den oppdager og undertrykker desinformasjon/falske nyheter for å opprettholde sannhet og nøyaktighet.

Takling av trolling

Trolling kan ødelegge online dialoger og avspore meningsfulle samtaler. Automatisert innholdsmoderering oppdager disse trollene og hjelper til med å opprettholde et positivt miljø. Tenk deg et klasserom. IT fungerer som den forsiktige kraften som fremmer konstruktive interaksjoner og gir brukerne en bedre opplevelse.

Dybdeanalyse

Tekstanalyse går utover bare søkeordgjenkjenning. Den forstår konteksten og fremmer ekte innhold samtidig som den fjerner skadelige fortellinger. Utover tekster oppdager bildegjenkjenningsverktøy upassende bilder. De sikrer at bildene stemmer overens med plattformstandardene.

Omfattende videomoderering

Videoinnhold dominerer det digitale rommet ettersom folk elsker engasjerende bilder. Automatisering trer inn for å garantere at disse videoene opprettholder spesifikke standarder. Den siler gjennom enorme innholdsvolumer, oppdager skadelige elementer og fjerner dem umiddelbart.

konklusjonen

Automatisert innholdsmoderering gir både fordeler og utfordringer. Den utmerker seg ved å fjerne uegnet innhold fra digitale plattformer. Imidlertid møter den også begrensninger og vekker debatter om sensur og teknologiens rolle. I mange tilfeller kreves det også ekspertmoderasjon fra mennesker i tilfelle tvetydighet.

Plattformer bør være tydelige på modereringsregler. De trenger også systemer for brukere for å utfordre beslutninger om fjerning av innhold for rettferdighet og nøyaktighet. Med den rette balansen kan vi oppnå rettferdighet for nettbrukere samtidig som vi opprettholder deres sikkerhet og opprettholder rettighetene deres.

Denne metoden fungerer på forhåndsdefinerte lister over forbudte eller flaggede ord. Når innholdet inneholder disse ordene, nekter systemet enten publiseringen eller sender det til vurdering. For eksempel kan plattformer blokkere eksplisitt språk eller termer knyttet til hatytringer.

Denne metoden fungerer på forhåndsdefinerte lister over forbudte eller flaggede ord. Når innholdet inneholder disse ordene, nekter systemet enten publiseringen eller sender det til vurdering. For eksempel kan plattformer blokkere eksplisitt språk eller termer knyttet til hatytringer. Ved å utnytte kraften til maskinlæring identifiserer denne metoden upassende eller flaggede bilder. Den kan oppdage bilder som fremmer vold, eksplisitt innhold eller opphavsrettsbeskyttet materiale. Avanserte algoritmer analyserer visuelle mønstre for å sikre at ingen skadelige bilder går ubemerket hen.

Ved å utnytte kraften til maskinlæring identifiserer denne metoden upassende eller flaggede bilder. Den kan oppdage bilder som fremmer vold, eksplisitt innhold eller opphavsrettsbeskyttet materiale. Avanserte algoritmer analyserer visuelle mønstre for å sikre at ingen skadelige bilder går ubemerket hen.

Det er viktig å forstå følelsen eller følelsene bak innholdet. Denne metoden evaluerer innholdstonen og flagger innhold som er altfor negativt, fremmer hat eller fremmer skadelige følelser. Det er spesielt nyttig i fora eller plattformer som fremmer positive fellesskapsinteraksjoner.

Det er viktig å forstå følelsen eller følelsene bak innholdet. Denne metoden evaluerer innholdstonen og flagger innhold som er altfor negativt, fremmer hat eller fremmer skadelige følelser. Det er spesielt nyttig i fora eller plattformer som fremmer positive fellesskapsinteraksjoner. Innhold krever ofte kontekst for nøyaktig moderering. Denne metoden evaluerer innhold innenfor dens omgivende kontekst. Det sikrer at ekte innhold, selv med flaggede ord, ikke blir feilaktig blokkert hvis den generelle konteksten er ufarlig. I eksemplet - det inneholder ordet "drep", i kontekst er det godartet, og refererer til den harmløse aktiviteten ved å spille spill

Innhold krever ofte kontekst for nøyaktig moderering. Denne metoden evaluerer innhold innenfor dens omgivende kontekst. Det sikrer at ekte innhold, selv med flaggede ord, ikke blir feilaktig blokkert hvis den generelle konteksten er ufarlig. I eksemplet - det inneholder ordet "drep", i kontekst er det godartet, og refererer til den harmløse aktiviteten ved å spille spill Brukere med en historie med brudd på retningslinjene kan kreve nærmere gransking. Dette systemet modereres basert på brukerens omdømme. De med tidligere overtredelser kan finne innholdet deres gjennomgått strengere enn de med et rent ark.

Brukere med en historie med brudd på retningslinjene kan kreve nærmere gransking. Dette systemet modereres basert på brukerens omdømme. De med tidligere overtredelser kan finne innholdet deres gjennomgått strengere enn de med et rent ark. Gitt det enorme innholdet som genereres på sosiale medier, overvåker spesialiserte verktøy disse plattformene. De oppdager potensielle problemer som desinformasjon, falske nyheter eller trolling i sanntid. Det bidrar til å skape et renere og tryggere miljø i sosiale medier.

Gitt det enorme innholdet som genereres på sosiale medier, overvåker spesialiserte verktøy disse plattformene. De oppdager potensielle problemer som desinformasjon, falske nyheter eller trolling i sanntid. Det bidrar til å skape et renere og tryggere miljø i sosiale medier.