Hvis du bruker Siri, Alexa, Cortana, Amazon Echo eller andre som en del av hverdagen, vil du godta at Talegjenkjenning har blitt en allestedsnærværende del av livene våre. Disse drevet av kunstig intelligens stemmeassistenter konverterer verbale spørsmål fra brukere til tekst, tolker og forstår hva brukeren sier for å komme med et passende svar.

Det er behov for kvalitetsdatainnsamling for å utvikle pålitelige tale-, gjenkjenningsmodeller. Men, utviklende programvare for talegjenkjenning er ikke en enkel oppgave – nettopp fordi det er vanskelig å transkribere menneskelig tale i all dens kompleksitet, som rytme, aksent, tonehøyde og klarhet. Og når du legger følelser til denne komplekse blandingen, blir det en utfordring.

Hva er talegjenkjenning?

Talegjenkjenning er programvarens evne til å gjenkjenne og behandle menneskelig tale inn i tekst. Mens forskjellen mellom stemmegjenkjenning og talegjenkjenning kan virke subjektiv for mange, er det noen grunnleggende forskjeller mellom de to.

Selv om både tale- og stemmegjenkjenning utgjør en del av stemmeassistentteknologien, utfører de to forskjellige funksjoner. Talegjenkjenning utfører automatiske transkripsjoner av menneskelig tale og kommandoer til tekst, mens stemmegjenkjenning kun tar for seg å gjenkjenne talerens stemme.

Typer talegjenkjenning

Før vi hopper inn typer talegjenkjenning, la oss ta en kort titt på talegjenkjenningsdata.

Talegjenkjenningsdata er en samling av menneskelige talelydopptak og teksttranskripsjon som hjelper med å trene maskinlæringssystemer for stemmegjenkjenning.

Lydopptakene og transkripsjonene legges inn i ML-systemet slik at algoritmen kan trenes til å gjenkjenne talens nyanser og forstå dens betydning.

Selv om det er mange steder du kan få gratis ferdigpakkede datasett, er det best å få tilpassede datasett for dine prosjekter. Du kan velge samlingsstørrelse, lyd- og høyttalerkrav og språk ved å ha et tilpasset datasett.

Taledataspektrum

Taledata Spektrum identifiserer kvaliteten og tonehøyden på tale som spenner fra naturlig til unaturlig.

Skript-data for talegjenkjenning

Som navnet antyder, er skriptet tale en kontrollert form for data. Foredragsholderne tar opp spesifikke fraser fra en forberedt tekst. Disse brukes vanligvis til å levere kommandoer, og understreker hvordan ord eller uttrykk blir sagt i stedet for det som blir sagt.

Skript talegjenkjenning kan brukes når du utvikler en stemmeassistent som skal fange opp kommandoer utstedt ved hjelp av varierte høyttaleraksenter.

Scenariobasert talegjenkjenning

I en scenariebasert tale blir foredragsholderen bedt om å forestille seg et bestemt scenario og utgi en stemmestyring basert på scenariet. På denne måten er resultatet en samling talekommandoer som ikke er skriptet, men kontrollert.

Scenariobasert taledata kreves av utviklere som ønsker å utvikle en enhet som forstår daglig tale med dens ulike nyanser. For eksempel å spørre om veibeskrivelse for å gå til nærmeste Pizza Hut ved å bruke en rekke spørsmål.

Naturlig talegjenkjenning

Helt på slutten av talespekteret er tale som er spontan, naturlig og ikke kontrollert på noen måte. Foredragsholderen snakker fritt ved å bruke sin naturlige samtaletone, språk, tonehøyde og tenor.

Hvis du ønsker å trene en ML-basert applikasjon på talegjenkjenning med flere høyttalere, må en uskriptet eller samtaletale datasett er nyttig.

Datainnsamlingskomponenter for taleprosjekter

Forstå nødvendige brukersvar

Start med å forstå de nødvendige brukersvarene for modellen. For å utvikle en talegjenkjenningsmodell bør du samle inn data som tett representerer innholdet du trenger. Samle inn data fra virkelige interaksjoner for å forstå brukerinteraksjoner og -svar. Hvis du bygger en AI-basert chat-assistent, se på chat-loggene, samtaleopptakene, svarene i chat-dialogboksen for å lage et datasett.

Undersøk det domenespesifikke språket

Du trenger både generisk og domenespesifikt innhold for et talegjenkjenningsdatasett. Når du har samlet inn generiske taledata, bør du sile gjennom dataene og skille generiske fra spesifikke.

Kunder kan for eksempel ringe inn for å be om time for å sjekke om det er glaukom på et øyesenter. Å be om en avtale er et svært generisk begrep, men glaukom er domenespesifikk.

Dessuten, når du trener en talegjenkjennings ML-modell, sørg for at du trener den til å identifisere fraser i stedet for individuelt gjenkjente ord.

Ta opp menneskelig tale

Etter å ha samlet inn data fra de to foregående trinnene, vil neste trinn innebære å få mennesker til å registrere de innsamlede utsagnene.

Det er viktig å opprettholde en ideell lengde på manuset. Å be folk lese mer enn 15 minutter med tekst kan virke mot sin hensikt. Oppretthold et minimum på 2 – 3 sekunder mellom hver innspilt uttalelse.

La opptaket være dynamisk

Bygg et talelager med forskjellige mennesker, taleaksenter, stiler som er tatt opp under forskjellige omstendigheter, enheter og miljøer. Hvis flertallet av fremtidige brukere skal bruke fasttelefonen, bør talesamlingsdatabasen din ha en betydelig representasjon som samsvarer med dette kravet.

Induser variasjon i taleopptak

Når målmiljøet er satt opp, ber du datainnsamlingsobjektene dine lese det forberedte skriptet under et lignende miljø. Be personene om ikke å bekymre seg for feilene og hold gjengivelsen så naturlig som mulig. Tanken er å ha en stor gruppe mennesker som spiller inn manuset i samme miljø.

Transkribere talene

Når du har tatt opp skriptet med flere emner (med feil), bør du fortsette med transkripsjonen. Hold feilene intakte, da dette vil hjelpe deg med å oppnå dynamikk og variasjon i innsamlede data.

I stedet for å la mennesker transkribere hele teksten ord for ord, kan du involvere en tale-til-tekst-motor for å gjøre transkripsjonen. Imidlertid foreslår vi også at du bruker menneskelige transkriberere for å rette opp feil.

Utvikle et testsett

Å utvikle et testsett er avgjørende siden det er en frontløper for språkmodell.

Lag et par av talen og tilhørende tekst og lag dem til segmenter.

Etter å ha samlet inn de innsamlede elementene, ta ut en prøve på 20 %, som utgjør testsettet. Det er ikke treningssettet, men disse utpakkede dataene vil gi deg beskjed hvis den trente modellen transkriberer lyd som den ikke har blitt trent på.

Bygg språktreningsmodell og mål

Bygg nå språkmodellen for talegjenkjenning ved å bruke domenespesifikke utsagn og ytterligere variasjoner om nødvendig. Når du har trent opp modellen, bør du begynne å måle den.

Ta treningsmodellen (med 80 % valgte lydsegmenter) og test den mot testsettet (ekstrahert 20 % datasett) for å se etter spådommer og pålitelighet. Se etter feil, mønstre og fokuser på miljøfaktorer som kan fikses.

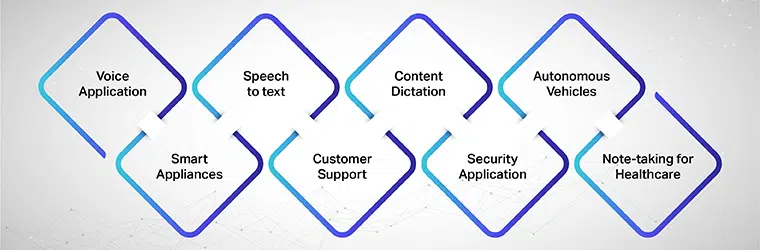

Mulige brukstilfeller eller applikasjoner

Stemmeapplikasjon, smarte apparater, tale til tekst, kundestøtte, innholdsdiktering, sikkerhetsapplikasjon, autonome kjøretøy, notattaking for helsevesenet.

Talegjenkjenning åpner en verden av muligheter, og brukertilpasningen av taleapplikasjoner har økt med årene.

Noen av de vanlige bruksområdene til talegjenkjenningsteknologi inkluderer:

Applikasjon for talesøk

Ifølge Google om 20% av søkene utført på Google-appen er tale. Åtte milliarder mennesker anslås å bruke stemmeassistenter innen 2023, en kraftig økning fra anslåtte 6.4 milliarder i 2022.

Bruken av talesøk har økt betydelig gjennom årene, og denne trenden er spådd å fortsette. Forbrukere er avhengige av talesøk for å søke, kjøpe produkter, finne bedrifter, finne lokale bedrifter og mer.

Hjemmeenheter/smartapparater

Stemmegjenkjenningsteknologi brukes til å gi stemmekommandoer til smarte hjemmeenheter som TV-er, lys og andre apparater. 66% av forbrukerne i Storbritannia, USA og Tyskland oppga at de brukte stemmeassistenter når de brukte smartenheter og høyttalere.

Tale til tekst

Tale-til-tekst-applikasjoner brukes til å hjelpe til med gratis databehandling når du skriver e-post, dokumenter, rapporter og andre. Tale til tekst eliminerer tiden til å skrive ut dokumenter, skrive bøker og e-poster, undertekste videoer og oversette tekst.

Kundeservice

Talegjenkjenningsapplikasjoner brukes hovedsakelig i kundeservice og support. Et talegjenkjenningssystem hjelper deg med å tilby kundeserviceløsninger 24/7 til en rimelig pris med et begrenset antall representanter.

Innholdsdiktering

Innholdsdiktering er en annen brukscase for talegjenkjenning som hjelper studenter og akademikere med å skrive omfattende innhold på en brøkdel av tiden. Det er ganske nyttig for studenter som er vanskeligstilt på grunn av blindhet eller synsproblemer.

Sikkerhetsapplikasjon

Stemmegjenkjenning brukes mye for sikkerhets- og autentiseringsformål ved å identifisere unike stemmeegenskaper. I stedet for å la personen identifisere seg ved å bruke personlig informasjon stjålet eller misbrukt, øker stemmebiometri sikkerheten.

Dessuten har stemmegjenkjenning for sikkerhetsformål forbedret kundetilfredshetsnivået ettersom det eliminerer den utvidede påloggingsprosessen og duplisering av legitimasjon.

Talekommandoer for kjøretøy

Kjøretøy, først og fremst biler, har nå en felles stemmegjenkjenningsfunksjon for å øke kjøresikkerheten. Det hjelper sjåførene med å fokusere på kjøringen ved å akseptere enkle talekommandoer som å velge radiostasjoner, ringe eller redusere volumet.

Notat for helsevesenet

Medisinsk transkripsjonsprogramvare bygget ved hjelp av talegjenkjenningsalgoritmer fanger enkelt opp legers stemmenotater, kommandoer, diagnoser og symptomer. Medisinsk notattaking øker kvaliteten og haster i helsevesenet.

Har du et talegjenkjenningsprosjekt i tankene som kan transformere virksomheten din? Alt du trenger er et tilpasset talegjenkjenningsdatasett.

En AI-basert talegjenkjenningsprogramvare må trenes på pålitelige datasett for maskinlæringsalgoritmer for å integrere syntaks, grammatikk, setningsstruktur, følelser og nyanser av menneskelig tale. Det viktigste er at programvaren kontinuerlig skal lære og reagere – vokse med hver interaksjon.

Hos Shaip tilbyr vi helt tilpassede datasett for talegjenkjenning for ulike maskinlæringsprosjekter. Med Shaip har du tilgang til skreddersydde treningsdata av høyeste kvalitet som kan brukes til å bygge og markedsføre et pålitelig talegjenkjenningssystem. Ta kontakt med våre eksperter for en omfattende forståelse av våre tilbud.

[Les også: Den komplette guiden til Conversational AI]